官网火速更新iPad Pro,和前代相比,这一次iPad Pro的最大变化不是A12Z处理器,而是背后的“火疖子”——从单摄像头提升到了双摄,同时增加了ToF模组,苹果称之为激光雷达扫描仪(LiDAR)。

在苹果的介绍中,这款激光雷达扫描仪采用了直接飞行时间(dToF)来进行测距。而ToF技术,我们在这两年的安卓手机上已经见过很多。早在2018年,OPPO R17 Pro和vivo NEX双屏版都搭载了ToF影像系统,而到了2019年,华为、三星等旗舰也上马了ToF。

在上次我们的iPad Pro解析文章中,重点做了A12Z的分析,指出这是为了配合苹果“AR+低价”战略推出的更新产品之后,就有热心的读者朋友在下面评论,希望能讲一下苹果的LiDAR。

说到底,苹果押宝的LiDAR和dToF,与我们平常见到的安卓方案又有什么不同?在这篇文章中,让我们一一道来。

神秘的dToF

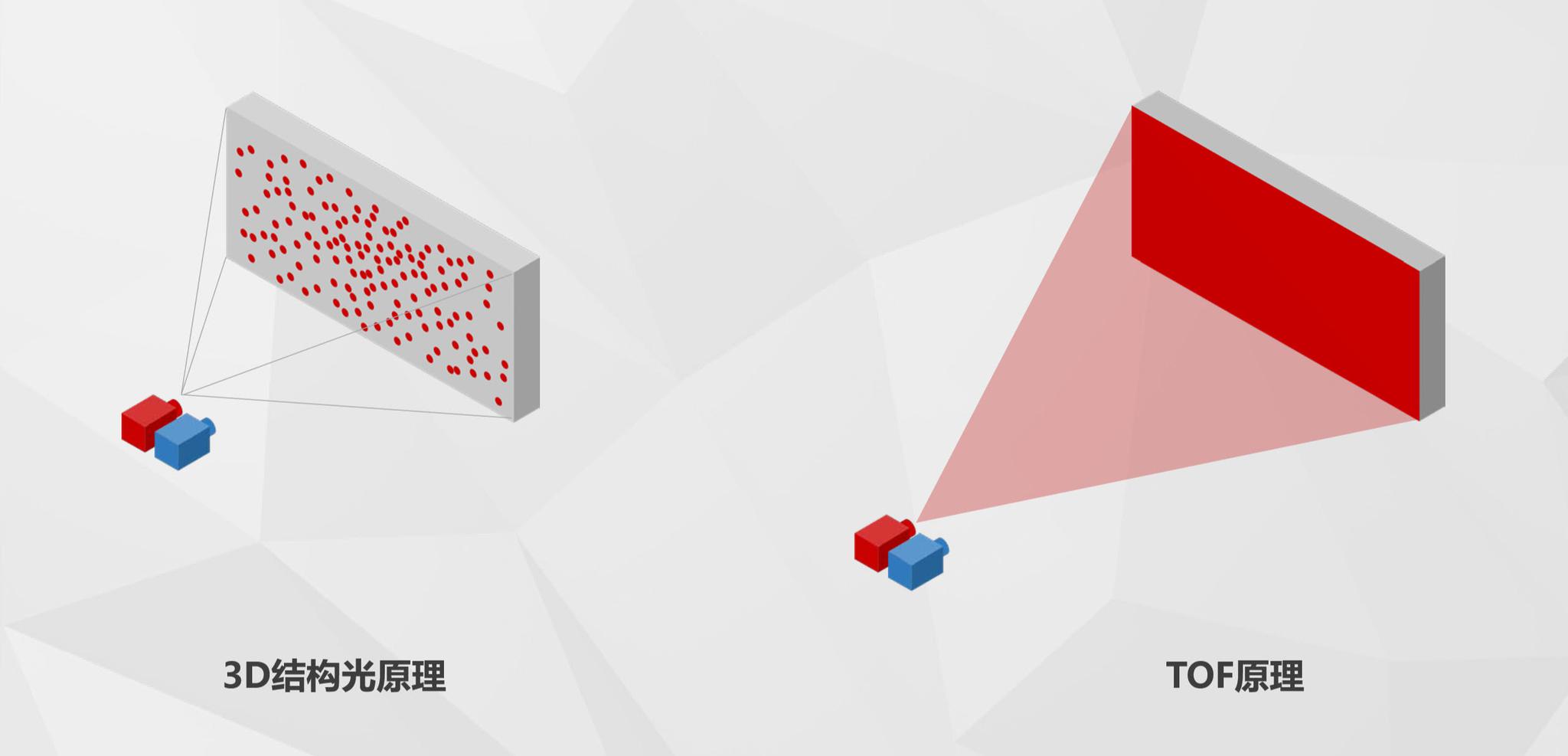

我们先来快速复习一下ToF的概念:ToF,全名“Time-of-Flight”(飞行时间测距法),是3D深度摄像头的其中一种方案。但和Face ID结构光提供点阵的方案不同,ToF投射的是一整个面,根据红外线的反射时间来计算深度信息,并且,ToF的测量范围达数米,不容易被强光所影响。

当然,ToF也带来了一些缺点,譬如分辨率低、模组复杂、价格昂贵等问题,它不适合分辨率要求高的前置摄像头(虽然有些厂商也上马了ToF的面部识别),主要应用在后置摄像头上。例如人的动作识别、建筑识别这种需要一定距离进行测绘的,都是ToF比结构光更有优势的地方。

那么回到当下的问题,苹果和安卓的ToF分别有什么不同呢?

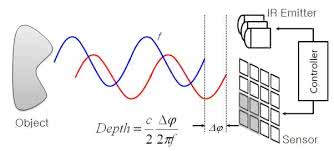

在现在的安卓大部分机型内,都采用的一种名为iToF的(indirect time of flight,间接ToF)技术。所谓间接ToF,并不是直接测量光发射返回的时间,而是根据相位偏移来间接计算距离。

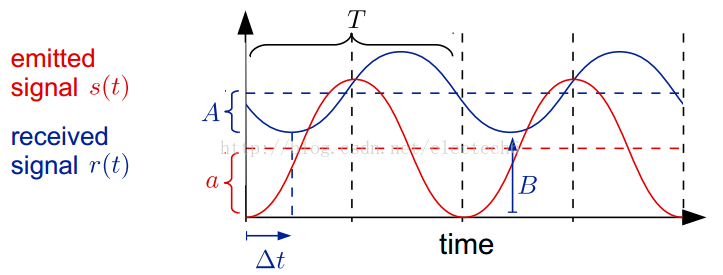

众所周知,光具有波粒二象性,也就是说我们可以通过发射光和返回光的相位偏差,和收发的时间进行函数运算,来获得具体的距离。例如激光发射器可以发射850nm的调制红外光,反射回来滤片过滤之后接收的自然也就是调制红外光。

具体计算方法比较复杂,这里就不进行阐述,但基本的测量指标只有几个基本要件:光发射的振幅、频率,而反射回来的光要经过四个快门的判定,以此来得出时延、衰减后的振幅以及强度偏移(环境光),最后就可以计算出相位偏移,而加上环境光影响的强度偏移,可以得出距离。

之所以iToF设立如此繁杂的机制,归根结底是因为有利于小型化。如今的手机上的iToF的芯片像素可以小到5um,以此来实现较高的分辨率(现在可以做到640*480左右)。并且系统容易集成,不需要额外的测量电路。不过这种运算方式,需要高帧率图像进行运算,功耗不小。

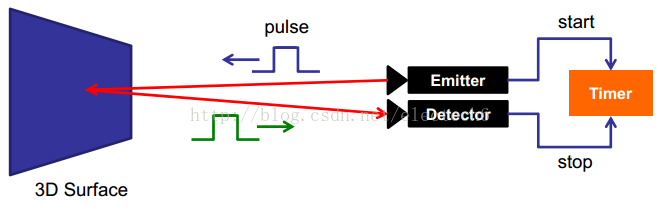

而相比之下,dToF的原理就简单多了,和手机厂商一开始和我们“科普”的一样。dToF只需要发射脉冲波,然后光反射回来被接收,只要计算光发射和返回的时间,自然就可以计算距离了。

但说起来简单,做起来难:和连续波不一样,脉冲波需要极高精密度的元器件进行检测,元器件需要对光精度很敏感,只有SPAD(单光子雪崩二极管)才能检测到微弱的光脉冲。

除了光检测之外,dToF电路还要对时间判断十分敏感,需要专门的高精密度时间检测(TDC)电路来进行计算,而连续波是从相位来判断的,自然不需要这个问题。

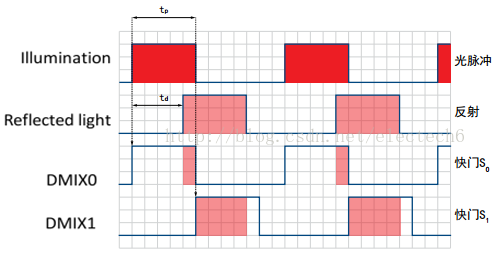

例如上图,第一条光是发射光的脉冲信号,第二条光则是返回收到的脉冲信号,而在接收器上会布置两个窗口,里面的SPAD将会把光信号变为电荷量。这两个窗口相位相反,因此两个窗口的电荷量之和就是反射光偏离(上图中的DMIX0与DMIX1的红色之和,恰好等于反射光的脉冲)。